黄仁勋GTC重磅演讲:发布AI电脑、人形机器人模型

来源:中阳国际期货 作者:qihuo

当地时间3月18日周二,英伟达CEO黄仁勋在加州圣何塞举行的英伟达AI盛会GTC 2025上发表主题演讲。

黄仁勋说,去年的GTC大会被誉为AI领域的Woodstock音乐节,今年GTC被称为AI行业的美版春晚“超级碗”,这两种称呼的唯一区别是,在“超级碗”,每个人都是赢家。

黄仁勋演讲覆盖了AI科技演进以及计算需求、即AI扩展定律的预测,同时公布了英伟达的Blackwell架构最新一代产品、此后几代产品的计划出货时间,英伟达在机器人(19.960, 0.01, 0.05%)领域合作研发的进展。要点包括:

我们将迈向代理式AI时代,接着是物理AI、即机器人时代,AI扩展定律、即计算需求在超快提速。

去年美国云服务商四巨头购买130万块Hopper架构芯片,今年已购360万Blackwell芯片,预计2028年数据中心资本支出规模突破1万亿美元。

通用汽车将用英伟达技术帮助开发自动驾驶汽车,英伟达推出汽车安全AI解决方案Halos;英伟达将与T-Mobile等电信公司合作开发用于6G的AI网络。

Blackwell架构全面投产,客户需求“难以置信”。

推出“AI工厂操作系统”Dynamo,Blackwell NVLink72芯片搭载Dynamo的推理性能是Hopper的40倍;Blackwell架构新品Ultra NVL72、即GB300预计今年下半年出货,下一代Rubin架构的Vera Rubin NVLink 144明年下半年后出货,之后一代Rubin Ulta NVL576将2027年下半年出货。

AI电脑DGX Spark和 DGX Station采用Blackwell芯片。

英伟达推出全球首款人形机器人功能模型GR00T N1,同DeepMind和迪士尼合作开发机器人模拟用开源物理引擎Newton,GR00T N1加持的机器人Blue和黄仁勋同台亮相,黄称“通用机器人时代已到来” 。

将迎来代理式AI时代 接下来物理AI AI扩展定律超快提速

他首先介绍了AI研发的发展历程,从最初的意识AI(Perception AI),到现在的生成式AI(Generative AI),他预计我们将进入代理式AI(Agentic AI)的时代,接下来将是物理AI(Physical AI)、也就是机器人的时代。

黄仁勋说,现在我们正在了解如何扩展 AI,未来必须关注训练和扩展构建的AI模型。他介绍AI的扩展定律(scaling law)发展演化,从预训练扩展、训练后扩展到测试时间扩展,即“长思维”。

黄仁勋认为去年行业对计算需求判断错误。他说:

“计算的需求、即AI的扩展定律更具韧性,而且实际上速度在超快提高(hyper-accelerated)。”

英伟达周二当天发布针对开发者和企业的开源AI模型系列,帮助他们打造Agentic AI平台,并针对企业发布Blackwell Ultra DGX SuperPOD。

四大美国云服务商今年已够130万Blackwell芯片

黄仁勋表示,现在我们“进行推理所需的计算量比以前大大增加”,而能够进行的数据和人工训练是有限的。未来将由人类编写软件过渡到由 AI 模型运行软件

黄仁勋介绍,AI计算相关的基础设施增长正处于转折点。

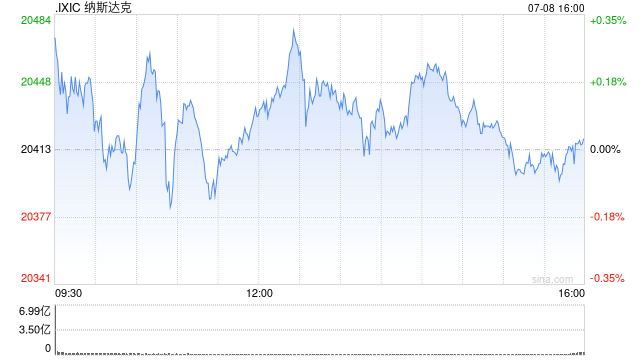

他透露,2024年,美国前四大云服务提供商(CSP)、所谓超大规模云服务商(hyperscaler)购买了130万块英伟达的Hopper架构芯片,2025年,又购买了360万Blackwell架构芯片。

黄仁勋预计,2028年,建设数据中心投入的资本支出将超过1万亿美元。

黄仁勋展示了英伟达简化加速平台处理与数据和AI等领域采用的CUDA-X库,称AI加速服务于多种行业各行各业都可应用CUDA-X库,称这只是实现加速计算的库的一小部分。

黄仁勋预测,每家公司未来都将有两个工厂,一是用于生产产品,另一个用于 AI数学。黄仁勋称,AI将进入所有行业。

与通用汽车合作开发自动驾驶汽车 与T-Mobile等公司合作开发用于6G的AI网络

黄仁勋宣布,英伟达将扩大与通用汽车的合作。通用汽车将运用英伟达的技术帮助开发自动驾驶汽车,用英伟达的技术训练AI制造模型。

英伟达推出了专注于汽车安全的AI解决方案,名为英伟达Halos。黄仁勋说:“我相信,我们是世界上第一家对每一行代码都进行安全评估的公司。”

黄仁勋还宣布,英伟达将与思科和T-Mobile等公司合作,研究和开发用于下一代无线网络6G的AI 原生网络。

Blackwell架构全面投产 NVLink72+Dynamo推理性能是Hopper的40倍

谈到数据中心,黄仁勋称,Blackwell架构的芯片已经全面投产,“客户需求令人难以置信(incredible)。”

他再次展示了今年1月CES上他演示的超级芯片Grace Blackwell NVLink 72。它在一个晶圆上集成了72个Blackwell GPU,并且有18个NVLink Switch,实现4位浮点数FP4上1.4 EFLOPS的计算性能。

英伟达推出号称未来“AI工厂操作系统”的新开源(17.250, -0.26, -1.48%)软件Dynamo。它是一个“分布式推理服务库”,基本上是一个开源解决方案,用于解决无法提供足够用户所需token的问题。微软和Perplexity是Dynamo的首批合作伙伴。

黄仁勋展示了Blackwell 架构如何超越Hopper超级计算机。用Grace Blackwell NVLink72芯片搭载Dynamo,Blackwell架构相比Hopper架构可将性能提升25倍。“在推理模型中,Blackwell 的性能是Hopper的 40 倍。”

黄仁勋开玩笑说,Hopper足以胜任一些任务,而出了Blackwell,“我是破坏收入的头子。”有了Blackwell等最新技术加持,搭建AI工厂的厂商“无论如何,你买得越多,就省得越多。”

Blackwell Ultra NVL72预计今年下半年出货 下一代Vera Rubin一年后出货

黄仁勋宣布英伟达芯片新品的消息,Blackwell系列的新品Blackwell Ultra NVL72 平台将于今年下半年出货,它的带宽是前代GB200的两倍,内存速度是前代的1.5倍。Blackwell Ultra有两个版本,一是基于Arm设计的CPU,名为GB300,另一个是名为B300的GPU。

英伟达称,Blackwell Ultra平台为AI推理时代铺路。GB300 NVL72 采用机架级设计,连接72块Blackwell Ultra GPU。相比Hopper架构,B300 NVL16 在大语言模型(LLM)上的推理速度提高了11倍,计算能力提高了 7 倍,内存增加了 4 倍,可为AI推理等最复杂的工作负载提供突破性的性能。

黄仁勋还公布了Blackwell之后下一代GPU架构Rubin AI数据中心芯片的计划面世时间。

英伟达预计,名为Vera Rubin的平台将于2026年下半年开始出货,它得到NVLink 144技术加持,包括名为Vera的英伟达首款定制CPU设计和名为Rubin的GPU设计。Vera Rubin NVLink 144的性能将是GB300 NVL 72的3.3倍。

相比三年前英伟达在GTC大会首次发布的前代Grace CPU,Vera芯片的性能提高一倍。Vera基于Olympus核心设计,Vera设计的速度将是去年采用Blackwell架构CPU的两倍。

Rubin 在进行推理时可以达到每秒 50 千万亿次浮点运算(petaflops)的速度,比当前Blackwell 芯片每秒 20 petaflops的速度高出一倍多。Rubin 还可以支持高达 288 GB 的快速内存。Rubin实际上是两块GPU,从Rubin开始,英伟达会将两个或多个芯片组合成一个芯片,将它们成为一个单独的GPU。